-

Постов

34 -

Зарегистрирован

-

Посещение

Посетители профиля

Достижения MERIAKRE

-

midjourney Спортивная Эстетика: Поларойд В Прошлом. Генерация из нейросети Midjourney

MERIAKRE опубликовал изображение в галерее в Midjourney примеры промтов

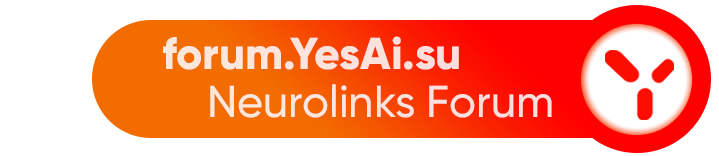

Спортивная Эстетика: Поларойд В Прошлом - Картинка, полученная с помощью нейросети Midjourney Спортивная ретро-эстетика: белокурая амазонка в стильном образе 70-х у красного кабриолета Ferrari возле советского многоквартирного дома, где время замерло на крыльце с сидящими бабушками. Полноформатная детализация и классический шарм полароидной съемки в каждой линии и гране ✏️ Промт: Фотография, сделанная полароидом. Белокурая длинноволосая амазонка спортивного телосложения в спортивной ретро-одежде, в спортивных черных очках, стоит возле красной ретро Ferrari. На фоне - крыльццо подьезда многоквартирного дома времён СССР. Возле подьезда лавочка. На лавке сидят две бабушки. Высокая детализация граней. 🧩 Нейросеть: 🖌 Midjourney 🛠 Функция: 🧬 Точная вариация 🎭 Стили: No style Эта иллюстрация создана алгоритмом ИИ @yes_ai_bot -

midjourney Спортивная Амазонка у Красной Феррари. Картинка из нейросети Миджорни

MERIAKRE опубликовал изображение в галерее в Midjourney примеры промтов

Спортивная Амазонка у Красной Феррари - Пример работы нейросети Миджорни Спортивная эстетика: амазонка в стиле ретро у красной Ferrari ✏️ Промт: Фотография, сделанная полароидом. Белокурая длинноволосая амазонка спортивного телосложения в спортивном широком треко, в облегающей майке КокаКола, спортивных черных очках, стоит возле красной ретро Ferrari. В правой руке держит бейсбольную биту на плече. На фоне - Двор и многоэтажки эпохи СССР. Утро. Высокая детализация граней. 🧩 Нейросеть: 🖌 Midjourney 🎭 Стили: No style Эта картинка сгенерирована при помощи алгоритма ИИ - midjourney- 1 комментарий

-

- 2

-

-

- meriakre

- бейсбольная бита

- (и ещё 5 )

-

midjourney Амазонка и Ретро: Спортивный Фотофьюжн. Картинка из нейронной сети Midjourney

MERIAKRE опубликовал изображение в галерее в Midjourney примеры промтов

Амазонка и Ретро: Спортивный Фотофьюжн - Генерация изображения с помощью нейросети Midjourney Спортивная изысканность в стиле ретро: белокурая амазонка у красной Ferrari ✏️ Промт: Фотография, сделанная полароидом. Белокурая длинноволосая амазонка спортивного телосложения в спортивном широком треко, майке Кокакола,в спортивных черных очках, стоит возле красной ретро Ferrari, держит в руке бейсбольную биту. На фоне - крыльццо подьезда многоквартирного дома времён СССР. Возле подьезда лавочка. На лавке сидят две бабушки. Высокая детализация граней. 🧩 Нейросеть: 🖌 Midjourney 🎭 Стили: No style Это изображение сгенерировано в - Yes Ai Bot- 1 комментарий

-

- 2

-

-

-

- советский многоквартирный дом

- бейсбольная бита

- (и ещё 5 )

-

midjourney Альтаир среди советских дворов. Генерация из нейронной сети Миджорни

MERIAKRE опубликовал изображение в галерее в Midjourney примеры промтов

Альтаир среди советских дворов - Пример генерации нейросети Миджорни Полароид запечатлевает сцену из игры, где Ассасин Альтаир гарцует на коне в неожиданном антураже – тихий двор советской эпохи утреннего города, окруженный старинными многоэтажками и оживленным присутствием местных бабушек ✏️ Промт: Полароидная фотография. Ассасин Альтаир ситит на коне, держит в руке длинный меч. На фоне жилой двор времён СССР. Вокруг многоквартирные старые дома. Возле подьезда на лавочке сидят бабушки. Утро. 🧩 Нейросеть: 🖌 Midjourney 🎭 Стили: No style 🧩 Нейросеть: midjourney- 1 комментарий

-

- 2

-

-

-

- советский стиль

- ассасин

- (и ещё 5 )

-

midjourney Отражение страха в зеркале. Нейросеть Midjourney

MERIAKRE опубликовал изображение в галерее в Midjourney примеры промтов

Отражение страха в зеркале - Генерация изображения с помощью нейросети Midjourney Отражение страха в зеркале: девушка перед старинным отражением сталкивается с зловещим взглядом Пеннивайза из далекого угла комнаты, где время замерло под фильтром старой полароидной камеры ✏️ Промт: The image filter of an old polaroid camera. The girl in the room is standing in front of a large mirror and sees her reflection, and far behind it, the evil clown Pennywise is looking out of the corner. 🧩 Нейросеть: 🖌 Midjourney 🎭 Стили: No style Эта картинка сгенерирована при помощи алгоритма ИИ: Yes Ai Bot- 1 комментарий

-

- 1

-

-

- repost

- старинная полароидная камера

- (и ещё 4 )

-

midjourney Путешествие на Красную планету: открытие марсианских секретов. Нейросеть Миджорни

MERIAKRE опубликовал изображение в галерее в Midjourney примеры промтов

Путешествие на Красную планету: открытие марсианских секретов - Пример изображения из нейросети Миджорни Космическая археология: исследование марсианских загадок на красной планете ✏️ Промт: Реалистично. На поверхности Марса стоит космический корабль. Возле него идет космонавт. Второй космонавт склонился над скелетом, изучая его. На фоне Марсианский пейзаж. 🧩 Нейросеть: 🖌 Midjourney 🎭 Стили: No style 🧩 Нейросеть: midjourney -

midjourney Старье Свежий: Оптимус и Бэмби у русской реки. Нейросеть Midjourney

MERIAKRE опубликовал изображение в галерее в Midjourney примеры промтов

Старье Свежий: Оптимус и Бэмби у русской реки - Пример изображения из нейросети Midjourney Захватывающее воспоминание времён, когда трансформеры и фантазия становились частью реальности, запечатлённое на старой полароидной фотографии: Оптимус Прайм и Бэмбильбе в умиротворяющей атмосфере деревенского берега реки, где коровы пасутся неподалёку, а вдалеке раскинулся старинный русский посёлок ✏️ Промт: The effect of an old polaroid photo. Optimus Prime and Bambelby are standing on the banks of a village river. Cows graze nearby. An old Russian village on the background. 🧩 Нейросеть: 🖌 Midjourney 🎭 Стили: No style 🧩 Нейросеть: midjourney- 1 комментарий

-

- 1

-

-

- элвин и букинист

- полароидное фото

- (и ещё 5 )

-

midjourney Старение Снакера и Друзей. Генерация из нейросети Миджорни

MERIAKRE опубликовал изображение в галерее в Midjourney примеры промтов

Старение Снакера и Друзей - Картинка, созданная нейросетью Миджорни Нostalgia in a Frame: King and Knights with Spiderman Before the Stone Fortress ✏️ Промт: Эффект старой фотографии на Полароид. Король в окружении рыцарей, стоит с Человеком-Пауком на фоне каменного замка. 🧩 Нейросеть: 🖌 Midjourney 🎭 Стили: No style 🧩 Нейросеть: midjourney- 1 комментарий

-

- старая фотография

- полароид

- (и ещё 4 )

-

midjourney Время замерло: Железный Человек в эпохе СССР. Изображение из нейросети Midjourney

MERIAKRE опубликовал изображение в галерее в Midjourney примеры промтов

Время замерло: Железный Человек в эпохе СССР - Пример работы нейросети Midjourney Встреча Железного Человека с милицией в атмосфере советского прошлого: портретное изображение на стиле ретро-полароид ✏️ Промт: Эффект старой фотографии на Полароид. Железный Человек и Российские милиционеры стоят возле небольшого табачного ларька. На фоне старые панельные Российские многоэтажки времён СССР. Четкие лица. Высокая детализация. 🧩 Нейросеть: 🖌 Midjourney 🎭 Стили: No style Этот рисунок создан нейронной сетью @yes_ai_bot- 1 комментарий

-

- 1

-

-

- советское архитектура

- табачный ларёк

- (и ещё 5 )

-

midjourney Реальность героев: ужин с Дэдпулом и Даенерис. Нейронная сеть Миджорни

MERIAKRE опубликовал изображение в галерее в Midjourney примеры промтов

Реальность героев: ужин с Дэдпулом и Даенерис - Пример генерации нейросети Миджорни Заголовок: Межмировое общение в стиле реальностиnnВ этом сюрреалистичном произведении Дэдпул воплощает образ обычного официанта, добавляя нотку неожиданности в строгий мир реализма. С подносом в руках и фартуком на поясе он перемещается среди повседневных реалий, становясь связующим звеном между фантастическими персонажами. Даенерис Таргариен, владычица драконов, и Железный Человек, защитник галактики, встречаются за ужином в обычном ресторане, где их присутствие кажется не менее реальным, чем шум городской суеты. Это произведение играет с границами возможного, смешивая вымышленные миры и придавая им осязаемость. Смелая интерпретация реализма позволяет зрителям увидеть знакомых героев под новым углом, приглашая их к размышлениям о месте фантазии в повседневной жизни ✏️ Промт: Реализм. Дэдпул в роли официанта в фартуке несет поднос с едой к столику в ресторане, за которым сидит Даенерис Таргариен и Железный Человек. 🧩 Нейросеть: 🖌 Midjourney 🎭 Стили: No style 🧩 Нейросеть: midjourney -

midjourney Девочка с топором против зомби на Майами. Изображение из нейронной сети Midjourney

MERIAKRE опубликовал изображение в галерее в Midjourney примеры промтов

Девочка с топором против зомби на Майами - Картинка, созданная ИИ Midjourney Десятилетняя героиня в мире апокалипсиса: непоколебимая воля против орды зомби на набережной Майами. Утренний пейзаж усиливает напряжение сюрреализма бытовой сцены ✏️ Промт: Реализм. Маленькая десятилетняя девочка держит в руке топор и идет по набережной Майами, вокруг бродят страшные зомби. На фоне пальмы, океан. Утро 🧩 Нейросеть: 🖌 Midjourney 🎭 Стили: No style 🧩 Нейросеть: midjourney -

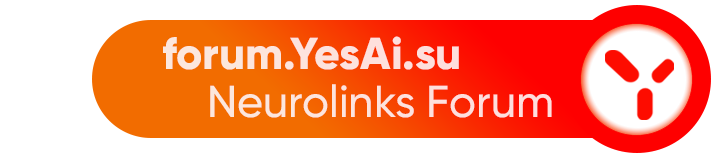

dalle Необычный союз времен в пещере: неандерталец и космонавт. dalle

MERIAKRE опубликовал изображение в галерее в Dalle примеры промтов

Необычный союз времен в пещере: неандерталец и космонавт - Пример работы нейросети dalle Современная интерпретация классики: сценка из будущего в неоклассическом антураже. Космонавт в футуристическом скафандре протягивает неандертальцу гамбургер, воплощая встречу времен под сенью первозданной природы ✏️ Prompt: A painting in the Neoclassical style. A man in a futuristic, space suit, holds out a McDonald's burger on a plate to a Neanderthal in torn clothes. In a cave, against the backdrop of prehistoric nature. 🧩 Model: 🔮 DALLE-3 [Multi-image] 🎭 Styles: No style 🧩 Нейросеть: dalle Этот рисунок создан нейронной сетью - Yes Ai Bot -

dalle Детализированный Кадр: Атлетка в Джунглях. dalle

MERIAKRE опубликовал изображение в галерее в Dalle примеры промтов

Детализированный Кадр: Атлетка в Джунглях - Пример изображения, сгенерированного нейросетью dalle Кинематографический портрет атлетичной девушки в тропическом ландшафте: высокодетализированный кадр с дальним планом показывает красноволосую героиню на футуристическом квад-байке среди экзотической растительности и животных, под акварельным закатом ✏️ Prompt: high detail, long shot, cinematic, high quality. athletic girl with long red hair, highly detailed face, dressed in a fitted military style short T-shirt and black sports short shorts. She is sitting on a futuristic quad bike surrounded by exotic jungle and fauna. The background is rocky landscapes, beautiful vegetation, sunset. 🧩 Model: 🔮 DALLE-3 [Multi-image] 🎭 Styles: No style 🧩 Нейросеть: dalle Этот рисунок создан с помощью ИИ dalle -

dalle Атлетичная Героиня с Дракончиком среди Растительности. dalle

MERIAKRE опубликовал изображение в галерее в Dalle примеры промтов

Атлетичная Героиня с Дракончиком среди Растительности - Генерация в нейросети dalle Атлетичная девушка с длинными рыжими волосами в облегательном тактическом костюме нежно держит черного драконенка посреди экзотических растений. Кадры из фильма высокого качества ✏️ Prompt: detail, stills from the film, high quality. an athletic girl with long red hair, dressed in a tight-fitting tactical suit, stands among many unusual plants and holds a black dragon cub in her arms. 🧩 Model: 🔮 DALLE-3 [Multi-image] 🎭 Styles: No style 🧩 Нейросеть: dalle -

Благодарю Вас за обратную связь. Здравствуйте. Увы, указанный Вами один из возможных вариантов уж слишком очевиден, что бы упереться в него головой и не заметить. Все настройки перед генерированием тщательно мониторятся и используются строго по необходимости. Так что, отвечая на Ваш вопрос - нет, стиль не менялся случайным образом, как и любые другие регулируемые параметры.