-

Постов

491 -

Зарегистрирован

-

Посещение

-

Победитель дней

9

Весь контент admin

-

Все верно, для получения бесплатных генераций нужно кому-то порекомендовать бота, так как бесплатные генерации не являются неотъемлемой частью тарифа, это по сути бонус от администрации. Буквально двумя сообщениями выше был подробно разобран и этот вопрос. Рекомендуем прочесть: https://forum.yesai.su/topic/621-bezlimitnyy-dostup-k-neyrosetyam-v-yes-ai-bot/?do=findComment&comment=5159

-

Здравствуйте, согласно прайсу (по ссылке): https://yesai.su/prices 1 генерация Sora Images: 🔅0.7 монет Каждая генерация в Sora Images - это 4 картинки по 🔅0.7 монет В день баланс на пакетах VIP восстанавливается на 🔅100 монет, делаем несложный расчет: ( 100 / 0.7 ) * 30 = 4260 изображений в месяц ИЛИ 142 в сутки. Но в пакетах VIP можно брать монеты авансом со следующего дня, что позволит делать больше генераций ежедневно. Подробнее про авансы написано тут: https://t.me/yes_ai_official/1359 Кроме того, монеты можно покупать отдельно (без покупки пакета VIP), в этом случае стоимость будет тем ниже, чем большее количество монет покупаете за раз. Для покупки монет или тарифов отправьте боту @yes_ai_bot команду /tariffs

-

Рекомендуем для создания обложек использовать нейросеть Sora Images, вот ссылка: https://t.me/yes_ai_bot?start=_soraimages Пример промта: обложка книги с зеленой обложкой, название книги "Живая энергия Жизни". красивые золотые узоры. Автор "LUBAVA" Вы можете добавлять к промту любые пожелания в свободной форме, вот еще пример для управления цветом обложки: обложка книги с зеленой обложкой разных оттенков, название книги "Живая энергия Жизни". красивые золотые узоры. Автор "LUBAVA"

-

Отвечаем по порядку важности тезисов, касающихся бесплатных генераций в нейросетях для пакетов VIP. Пункт номер НОЛЬ: Уважаемый Makentosh, объясняем, почему у вас не сработали бесплатные генерации. К сожалению, вы в данном обращении НЕ указали, что использовали именно нейросеть Flux.1. Однако именно для нее в условиях предоставления бесплатных генераций указано следующее: «Генерации изображений в нейросети Flux.1 (при максимальной ширине и/или высоте не более 1024 пикселей), в том числе с использованием моделей LoRA». Чего вы не учли: при генерациях у вас использовалось соотношение сторон 900×1600 пикселей — это выходит за рамки действия безлимита для нейросети Flux.1. Как решить эту проблему в будущем? Пожалуйста, читайте описание внимательнее 🙏 Но для полноценного ответа на вопрос о бесплатных генерациях мы упомянем и другие важные пункты, с которыми часто сталкиваются пользователи. 1. Важно понимать, что бесплатные генерации (с разумными ограничениями) не являются неотъемлемой частью пакетов VIP. Данная опция предоставляется по усмотрению администрации для обладателей пакетов VIP. Об этом написано в оферте в начале этого топика: «Данное предложение не является офертой, Yes Ai оставляет за собой право изменить правила предоставления безлимитов в любой момент». Если вы поняли, что это НЕ является офертой, двигаемся дальше. 2. Если пользователь очень активно пользуется ботом, у системы есть основания полагать, что он потенциально может злоупотреблять безлимитными генерациями, либо использует телеграм-аккаунт не один, либо автоматизирует действия внутри системы. По этой причине (для обеспечения безопасности) бесплатные генерации временно ограничиваются для пользователя. Важно: система ничего не утверждает, в частности — НЕ утверждается, что пользователь совершает какие-либо действия со злым умыслом, НО система вправе ограничить бесплатные генерации для обеспечения собственной безопасности. 3. Ограничения на бесплатные генерации в пакетах VIP накладываются автоматически, точно так же (автоматически) они снимаются спустя некоторое время. Когда снимается ограничение на бесплатные генерации: рекомендуем подождать до СЛЕДУЮЩЕГО дня, либо для генераций вы можете использовать монеты, которые включены в пакет. Напоминаем, что вы можете забирать монеты авансом из пакета — об этом рассказано здесь: https://t.me/yes_ai_official/1359 4. Как избежать ограничений бесплатных генераций на пакете VIP в будущем? Всего два простых тезиса: Если пользователь ведет среднестатистический образ жизни (спит, делает перерывы на обед, иногда отдыхает от нейросетей) и не использует бота постоянно, то бесплатные генерации не отключатся вплоть до окончания срока действия пакета VIP. Если пользователь генерирует в нейросетях больше, чем среднестатистический человек, для него действуют стандартные опции пакета VIP, описанные в тарифах: https://forum.yesai.su/topic/412-tarify-yes-ai-bot (в том числе ежедневные начисления монет, баллов и возможность получать монеты и баллы авансом).

-

нейросеть Sora Images не поддерживает негативные промты в чистом виде, вместо этого следует четко указывать, что именно вы хотите видеть на изображении. Например, если вы не хотите, чтобы на человеке был синий пиджак, то просто укажите, какого цвета должен быть этот пиджак. Другими словами, нужно просто более подробно описывать то, что вы хотите видеть.

- 4 ответа

-

- sora

- sora images

-

(и ещё 2 )

C тегом:

-

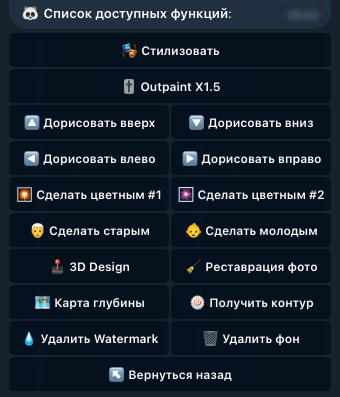

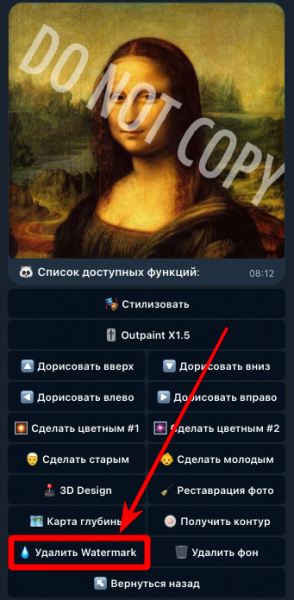

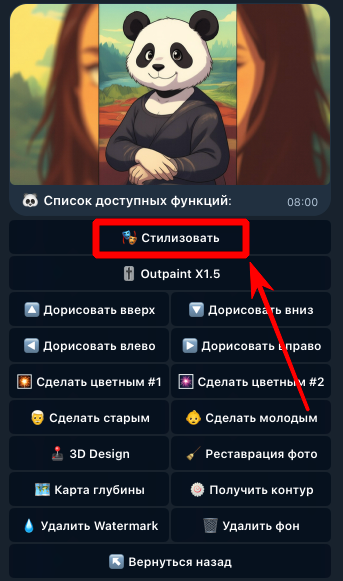

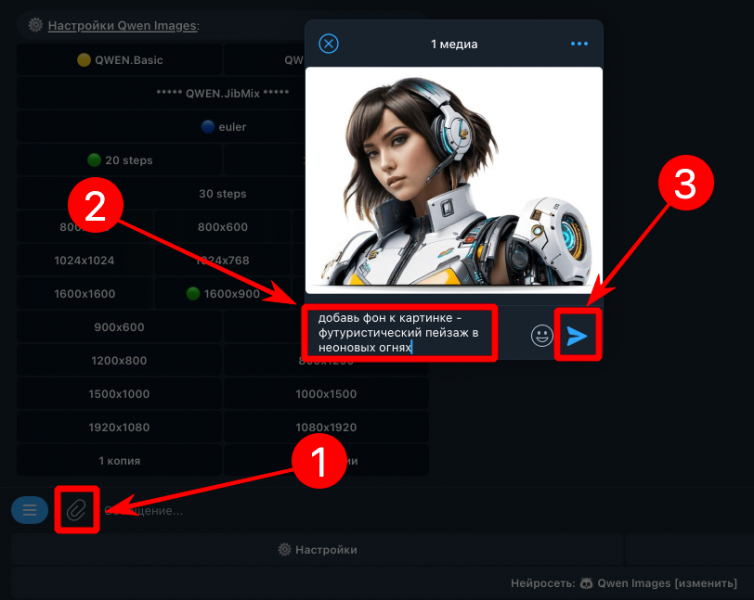

Нейросеть Qwen Images подходит не только для генерации, но и для обработки изображений и фото: стилизации, удаления фона, реставрации фотографий и редактирования картинок по промту. Список возможностей Qwen Images уже очень широк и будет расширяться с выходом обновленных моделей Qwen Image Edit. Вот основные функции Qwen Images для обработки фото и изображений: изменение отдельных деталей на изображении по описанию в промте; стилизация фото и картинок (например, применение аниме-стиля к фотографии) [выполнить в боте] удаление водяных знаков с изображения [выполнить в боте] реставрация старых фотографий и улучшение качества фото [выполнить в боте] генерация фотографий интерьера по чертежам или наброскам; генерация чертежей (контуров) интерьера по фотографиям; раскрашивание черно-белых фотографий [выполнить в боте] удаление фона с изображения или замена фона на белый [выполнить в боте] [beta] Outpaint — дорисовка областей изображения с учетом контекста (справа, слева, сверху, снизу или вокруг); преобразование объектов и персонажей в их 3D версии; поворот объектов и персонажей; генерация карты глубины по картинке; изменение возраста персонажей (сделать старше или моложе); замена одежды на человеке по описанию; [скоро] замена одежды на человеке по фотографии; замена черт лица, цвета кожи и прочих деталей у людей и персонажей; исправление дефектов внешности; [unstable] экстракция (извлечение) элементов одежды с фотографий. В этом списке перечислены далеко не все возможности обработки изображений в Qwen. Важно отметить, что у нейросети нет жестко заданных встроенных режимов для каждой задачи: вы отправляете в Qwen картинку и промт с описанием того, что нужно сделать, а ИИ редактирует изображение, опираясь на текст запроса. 👆 Этот момент является ключевым! С одной стороны, возможность самостоятельно описывать нужные изменения позволяет гибко редактировать изображения, но у такого подхода есть несколько недостатков: результат преобразования может сильно зависеть от исходного изображения. Например, функция Outpaint (дорисовка), доступная в Yes Ai Bot, на одних картинках дает стабильный результат, а на других может добавлять пустые области без учета контекста. Сейчас эта функция работает в бета-режиме; нейросеть может не сразу понять задачу, поэтому для стабильного результата иногда приходится подбирать более точный промт; некоторые задачи нейросеть может выполнять нестабильно, и это становится понятно только после теста. 💡 Обязательно учитывайте описанные выше особенности: оплата берется за сам факт генерации, а не за конечный результат. Подробнее об этом рассказано в статье "Почему нейросети не возвращают деньги". Хорошая новость в том, что Qwen — достаточно продвинутая нейросеть для обработки изображений, которая справляется с перечисленными задачами лучше многих конкурентов. Да, иногда нужный результат получается не с первой попытки, и во многих случаях достаточно доработать промт — это приходит с опытом. В Telegram-боте Yes Ai многие функции Qwen для обработки изображений доступны в «однокнопочном» формате: достаточно отправить боту картинку и выбрать нужную кнопку из списка. Это заметно упрощает редактирование фото. Разберем на примерах. Как удалить водяной знак с изображения в Qwen откройте бота по ссылке @yes_ai_bot отправьте изображение, с которого нужно удалить водяной знак; в появившемся меню откройте список доступных функций кнопкой "🐼 Функции Qwen"; нажмите на кнопку "💧 Удалить Watermark" и дождитесь результата. Как стилизовать фото в Qwen Стилизация фото в Qwen позволяет полностью изменить визуальный стиль изображения, сохранив при этом общие черты персонажей, лица и окружения. Покажем это на примере: переходим в бота по этой ссылке @yes_ai_bot отправляем фотографию, например, с вашим прекрасным лицом; в появившемся меню нажмите кнопку "🎭 Стилизовать"; выберите любой из стилей в списке (обратите внимание, что список можно листать влево и вправо), стилизация запустится автоматически, останется только дождаться результата. Как редактировать изображения по промту в Qwen Выше мы разобрали функции Qwen, которые разработчики Yes Ai вынесли в отдельные кнопки, но основной возможностью остается редактирование изображений по собственным промтам. В этом случае вам нужно самостоятельно описать текстом, как именно следует изменить исходное изображение. Писать промты для Qwen Images можно на любом языке и в свободной форме, если вы работаете через Yes Ai Bot. Однако старайтесь не перегружать задачу лишними деталями: лаконичный и точный промт обычно работает лучше. Откройте бота Yes Ai. Отправьте изображение вместе с текстовым примечанием, оно будет автоматически применено в качестве промта при генерации. В появившемся меню нажмите кнопку "🌇 Референс картинки" и дождитесь результата. Все инструменты редактирования изображений в боте Yes Ai работают по следующим принципам: Пропорции при генерации берутся из исходного изображения, а не из базовых настроек бота. Если используются функции категории «Outpaint», пропорции вычисляются автоматически, но площадь изображения, сгенерированного нейросетью, ограничена порогом в 1,2 мегапикселя. Если результат нужно увеличить, используйте отдельный инструмент: [Как сделать апскейл картинки через нейросеть] Если вы хотите сделать Outpaint, не указывайте это в промте при использовании функции "🌇 Референс картинки". Дорисовка работает только через отдельные функции в меню "🐼 Функции Qwen". В ближайшее время мы расширим эту инструкцию, так как уже работаем над новыми возможностями обработки изображений в Qwen Image Edit. Об обновлениях мы сообщим в нашем Telegram-канале: https://t.me/yes_ai_official По всем вопросам обращайтесь в наш чат: https://t.me/yes_ai_talk Если вы еще не читали первую статью с описанием базовых функций Qwen, то следует сделать это:

-

- 3

-

-

-

- обработка изображений

- удаление фона

- (и ещё 3 )

-

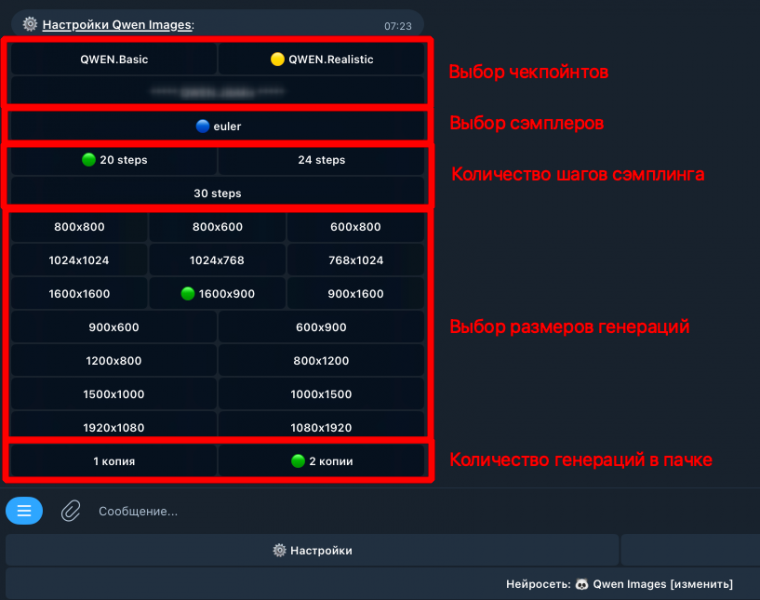

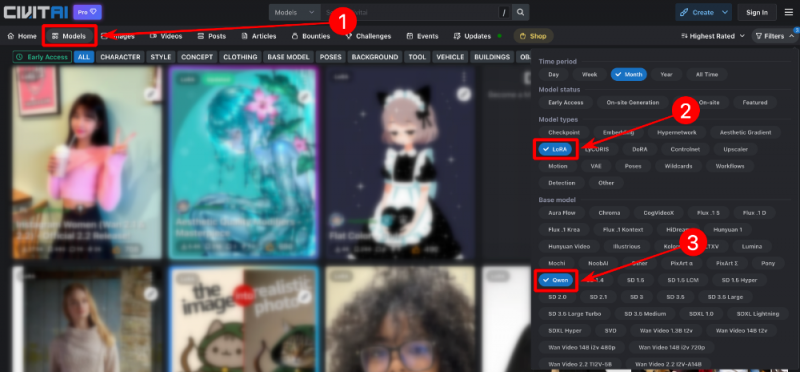

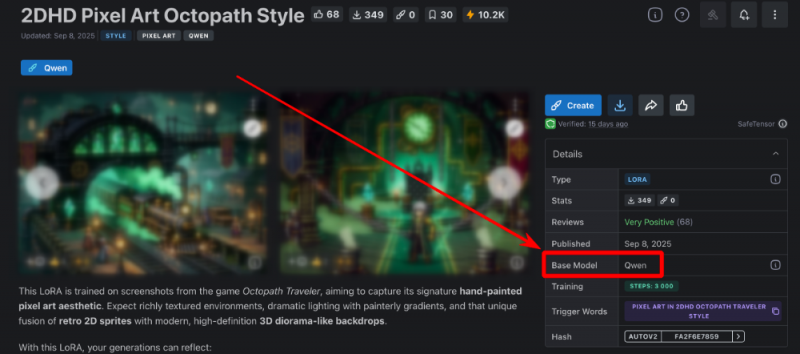

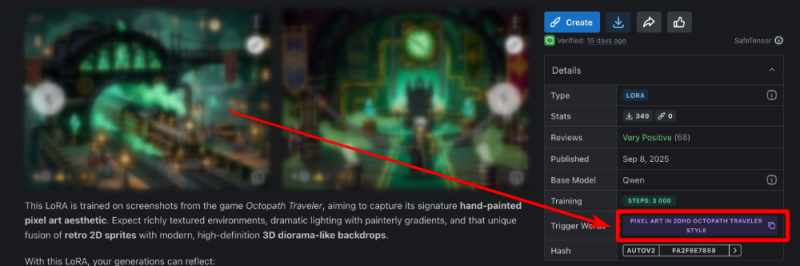

Нейросеть Qwen Images от разработчиков из Китая, хоть и можно условно назвать логическим продолжением Flux.1, ведь уровень качества их генераций очень близок, но в некоторых аспектах Qwen на голову выше оппонента. Нейросеть Qwen справляется с множеством задач, но основной "фишкой" можно без сомнений считать широкие возможности обработки изображений, а не простые генерации по промтам. Объясним суть проблем, которые способна решить нейросеть Qwen. Обработка изображений Проблема большинства пропиетарных нейросетей (Midjourney, Sora Images и пр.), предоставляющих возможность обрабатывать ваши изображения, заключается в том, что в них используются через чур жесткие NSFW-фильтры (not safe for work), которые часто ограничивают генерации, которые НЕ содержат ничего запрещенного. А Квен может быть установлен на собственных серверах, поэтому фильтрация контента будет работать более адекватно. Да, базовые версии Qwen не генерируют NSFW, так как не обучены для этих целей, но за мелкие нарушения вы хотя бы не получите бан. Если будет замечено подозрение на "запрещенку", то генерация будет выполнена в "дистиллированном" виде (без NSFW). А теперь перейдем к самой важной части — к функциям обработки картинок. Вы можете загрузить в Qwen собственные изображения с целью переработки и стилизации, вот некоторые опции: Замена одежды на персонаже или иные модификации окружения с сохранением черт лица оригинала (нейросети Midjourney и Sora Images молча завидуют Квену =) ) [скоро] Объединение нескольких изображений (аналогично тому, как это работает в Sora Images). [скоро] Замена одежды на человеке по фотографии человека и элементов одежды. [скоро] Поддержка карты глубины (depth map) (из Control.Net) для получения более предсказуемых результатов. [скоро] Поддержка шаблонов Open Pose для управления позами персонажей (из Control.Net). Замена стиля на тот, который описан в промте, например, из собственной фотографии можно создать аниме аватар [выполнить в боте] Реставрация старых фото в один клик [выполнить в боте] [beta] Дорисовка областей слева, справа, внизу, вверху, вокруг (Outpaint), пока работает не для всех картинок, но это решаемо. Расскажем об этом в отдельной статье. Колоризация черно-белых фото (сделать фотографии цветными) [выполнить в боте] Реставрация фото без изменения образов персонажей. Преобразование объектов в 3D-модели. [beta] Экстракция одежды для маркетплейсов (работает не очень стабильно). Можно с фотографии вытащить одежду. Удаление водяных знаков [выполнить в боте] Удаление фона (замена фона на белый) [выполнить в боте] Свободная модификация картинок с использованием произвольного промта. ...это далеко не все. Полный список возможностей почти безграничен, ведь вы сами можете описать, что именно нужно сделать с фотографиями. Неплохой список достоинств, не правда ли ? Это не все, вот еще пара важных моментов... Лица людей при модификации референсов не изменяются (остаются оригинальными), если иное не указано в промте. Умеет писать текст на английском и китайском, причем, не просто текст, а слова и фразы, разделенные на фрагменты. Например, можно сделать обложку журнала, где будет четко выделен заголовок, название и дополнительные блоки текста. Квен поддерживает LoRA (Low-Rank Adaptation), вы можете расширять базу знаний Qwen за счет обученных моделей, которые можно установить, например, с сайта civitai.com в Yes Ai Bot (в мессенджере Телеграм). Недостатки нейросети Qwen Images Qwen — не волшебная палочка, а нейросеть, способности которой не безграничны. Перечислим некоторые сложности, с которыми вы можете столкнуться: При дорисовке (Outpaint) добавляемые области могут не всегда соответствовать референсу, но эта проблема часто решается повторными попытками или пост-модификациями Достаточно высокая нагрузка на железо, без дорогостоящего оборудования практически не обойтись (либо придется долго ждать генераций). Рекомендуем видеокарты не ниже NVIDIA 3090, в идеале 4090 или 5090, так что придется выложить из кармана лишние (или не лишние?) несколько тысяч долларов. Жалко денег? Тогда не придется покупать собственное железо, все функции Qwen доступны в Telegram-боте @yes_ai_bot При работе с референсами иногда может происходить неожиданная замена элементов, например, фона, хотя в промте об этом не упоминалось Не самая богатая база знаний терминов, словарный запас заметно ниже, чем у той же Sora Images Не поддерживаются никакие языки кроме английского и китайского Как сгенерировать картинки в Qwen Images Разберем процесс на примере Yes Ai Bot, в котором доступна эта нейросеть. Перейдите по ссылке в Телеграм-бота @yes_ai_bot Сделайте настройки, если необходимо: можно выбрать модель (чекпойнт), количество шагов сэмплинга (почти всегда достаточно 20), размер генераций (в пикселях) и количество генераций для каждого запроса. Выберите стиль из галереи, если лень самостоятельно придумывать сложные промты. Отправьте промт на любом языке (сервис Yes Ai автоматически переведет его на английский). Настройки для нейросети Qwen Images: модель (чекпойнт): определяет базовую стилистику изображения, чекпойнты обучены на разных дата-сетах, что позволяет им делать совершенно уникальные генерации. Например, можно выбрать чекпойнт, который больше "заточен" под генерации в стиле реализм, если требуется повышенная фотореалистичность; количество шагов сэмплинга: чем их больше, тем большее количество раз нейросеть будет "додумывать" содержимое генераций, но тем больше будет стоимость и время ожидания. В 99% случаев будет достаточно 20 шагов; размер генераций: вы можете выбрать формат 1:1 / 2:3 / 3:2 / 9:16 / 16:9, причем доступны различные размеры (в настройках они указаны в пикселях); количество генераций: если выбрана 1 копия, то на каждый отправленный промт будет создаваться только 1 картинка, если выбрано 2 копии, то будет два уникальных результата и т.д. Если вам нужны примеры промтов для генераций, рекомендуем открыть бесплатную галерею на нашем форуме. Как генерировать изображение в Qwen Images с использованием моделей LoRA Если коротко, то нужно делать все то же самое, что описано предыдущей 👆 инструкции, но к тексту промтов требуется добавлять ключ с номером заранее установленной модели LoRA и весовым коэффициентом. Пример промта с использованием Qwen LoRA: панда кушает лапшу из миски <lora:1938784:1.1> pixel art in 2dhd octopath traveler style ...где <lora:1938784:1.1> — это ключ активации модели LoRA: "1938784" - номер модели с сайта civitai.com "1.1" - это весовой коэффициент, обычно он варьируется в диапазоне от 0.7 до 1.5 (зависит от того, как была обучена выбранная модель Лоры) "pixel art in 2dhd octopath traveler style" - триггерные слова для активации модели А теперь разберемся, где брать номер LoRA для ключей формата <lora:1938784:1> Во-первых в Yes Ai Bot есть галерея моделей Лора, которые ранее были установлены другими пользователями. Вы можете копировать ключи моделей прямо оттуда, но не забывайте вставлять в промт и триггерные слова, если они присутствуют в карточке описания. Как установить модель Qwen LoRA с сайта Civitai в галерею Yes Ai Если вам не хватает выбора моделей из галереи Yes Ai, добавьте то, что найдете на сайте Civitai (это большая библиотека моделей, обученных энтузиастами со всего мира). Для начала вам нужно определиться, какую модель планируете использовать для генераций, сделать это можно на сайте Civitai по ссылке: https://civitai.com/models. ⚠️ В фильтрах выберите два пункта: "LoRA" и "Qwen". В появившемся списке выберите понравившуюся модель, отвечающую вашей идее по стилистике или функциям (читайте описания моделей, в них авторы пишут, что именно делает та или иная Лора). Перейдите в карточку модели и скопируйте ссылку из строки браузера, например: https://civitai.com/models/1938784/2dhd-pixel-art-octopath-style Скопированную ссылку нужно отправить боту Yes Ai в Телеграм, система все проверит и добавит модель в галерею в течение 5-15 минут. Обратите внимание, что для Qwen можно устанавливать только те модели, у которых стоит пометка "Base model: Qwen". А когда будете отправлять ссылку боту, убедитесь, что в нижнем меню выбрана именно нейросеть Qwen: надпись на кнопке "Нейросеть: Qwen Images [изменить]". Когда Лора будет успешно добавлена в систему, вы можете отправлять промты, содержащие соответствующий ключ, в нашем примере он будет выглядеть так: <lora:1938784:1>, где 1938784 — это номер модели (его можно увидеть в ссылке, которую вы скопировали с сайта Civitai. Тут явно чего-то не хватает! Не хватает триггерных слов, ведь они были предусмотрены автором этой модели (речь про "671809"). Триггерные слова — это текст, который требуется отправлять вместе с вашим промтом, чтобы LoRA работала именно так, как задумал автор. Для рассматриваемой модели действительно предусмотрена триггерная фраза: pixel art in 2dhd octopath traveler style Теперь собираем все по частям, нам нужен промт, который создаст картинку с пандой... панда кушает лапшу из миски <lora:1938784:1> pixel art in 2dhd octopath traveler style Может возникнуть логичный вопрос "А ничего, что часть промта написана на русском языке, а триггерные слова на английском?". Отвечаем: Не беспокойтесь об этом, система Yes Ai автоматически все отрегулирует и сделает правильную генерацию, так что можно миксовать два языка в одном запросе. Если вы используете Qwen на своем компьютере, то необходимо весь промт вводить на английском языке. Как выбирать весовой коэффициент для Лоры и на что он влияет? Весовой коэффициент для LoRA определяет силу ее воздействия на создаваемую генерацию, чем он выше, тем сильнее модель проявит свои признаки. В командах для Yes Ai Bot весовой коэффициент указывается после номера модели, например: <lora:1938784:1.2> ...здесь число "1.2" — это весовой коэффициент, влияющий на силу модели с номером 1938784. Как уже было отмечено ранее, весовой коэффициент обычно варьируется в диапазоне от 0.7 до 1.5, но тут нет строгих правил, т.к. некоторые авторы при обучении LoRA могут использовать иные значения. По этой причине следует обратить внимание на две вещи: описание модели в карточке на сайте Civitai - иногда авторы указывают диапазоны изменения весовых коэффициентов; примеры генераций, сделанных автором (они также видны в карточках моделей). В описании картинок есть промты, а в промтах иногда указан вес моделей Лора. Если в карточке модели ничего полезного не нашли, то смело ставьте вес равный единице и тестируйте, тестируйте, тестируйте... ведь качественный результат вы, так или иначе, получите не сразу, а лишь спустя какое-то количество итераций (повторений). Если вес, равный единице не дал ожидаемых результатов, увеличьте или уменьшите его, в зависимости от полученных ранее генераций. ...НЕ мечтайте, что все начнет получаться с первых попыток, нейросети так не работают. Хотите упростить себе жизнь и получить проверенные промты? Тогда можно направиться в галерею на нашем форуме, там размещено множество примеров настроек и промтов для нейросети Qwen Images. Будем считать, что вопрос с простыми генерациями по промтам и с моделями LoRA мы разобрали, но, если у вас остались вопросы, задайте их в Телеграм: https://t.me/yes_ai_talk Следующая важная статья — использование функций нейросети Qwen Images, в которой мы разберем полезные штуки вроде удаления фона, стилизации и работы с референсами. Настоятельно рекомендуем к ознакомлению: https://forum.yesai.su/topic/3056-neyroset-qwen-obrabotka-izobrazheniy-stilizaciya-udalenie-fona-restavraciya/

-

- 1

-

-

- images

- генерация картинок

- (и ещё 3 )

-

1. на будущее просьба размещать пожелания в разделе пожеланий (ваш топик мы уже перенесли сами) 2. мы учтем ваше пожелание, но хотим обратить внимание, что там уже есть бонус за пополнения - в течение часа после покупки любого количества монет вам предоставляется скидка на следующую покупку монет - так что вы уже можете экономить, просто делая по две покупки монет подряд

-

Нуждаюсь в советах и помощи

admin ответил Marina_Shumi вопрос в Вопросы о нейросетях и ответы на них

вы хотите чтобы нейросеть создавала чертежи по описанию ? это очень непростая задача, ибо нейронки работают в большей степени с более абстрактными задачами. ну или вам следует более подробно описать суть задачи с примерами -

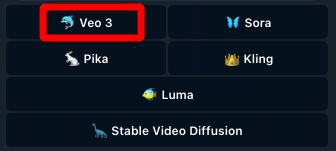

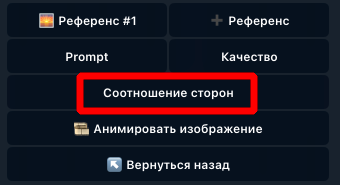

veo 3 Как сделать вертикальное (портретное) видео 9:16 в Veo 3

admin опубликовал тема в Нейросети для Видео

В Veo 3 можно сделать вертикальное видео 9:16: нейросеть поддерживает портретный формат и позволяет генерировать ролики для TikTok, Shorts и других мобильных платформ. При этом сохраняются и другие возможности — использование стартового кадра, озвучка текста из промта, озвучка текста из титров и другие функции. Поддержка формата 9:16 в Veo 3 появилась 9 сентября 2025 года. До недавнего времени Veo 3 умела генерировать только видео в горизонтальном формате 16:9, что подходило для YouTube, RuTube и других подобных платформ. Однако для TikTok, Shorts и просмотра со смартфона такой формат подходит хуже, чем вертикальное видео 9:16. Поэтому пользователям приходилось использовать сторонние нейросети и сервисы, чтобы преобразовывать горизонтальные ролики в вертикальные. Теперь Veo 3 нативно поддерживает генерацию видео как в формате 9:16, так и в формате 16:9. 💡 В конце статьи также покажем полезную функцию Veo 3 для озвучки текста, но сначала разберем, как сделать вертикальное видео 9:16. Как сделать вертикальное видео 9:16 в Veo 3 Разберем эту возможность на примере Yes Ai Bot: Откройте раздел Yes Video в Телеграм-боте @yes_ai_bot Отправьте боту промт или изображение вместе с промтом. Также можно загрузить сразу две картинки: в этом случае первая будет использована как стартовый кадр, а вторая — как финальный. В появившемся меню выберите нейросеть "🐬 Veo 3"; Нажмите кнопку «Соотношение сторон» и выберите нужный формат видео: Auto (автоматический режим), 16:9 (горизонтальный формат) или 9:16 (вертикальный формат). Чтобы сделать вертикальное видео в Veo 3, выберите 9:16.* * "Auto" — автоматический режим, выбранный по умолчанию. Если вы загрузите квадратный или горизонтальный референс, Veo 3 создаст видео в формате 16:9. Если загрузите вертикальный референс, нейросеть сгенерирует видео в формате 9:16. Если запускать генерацию без референса, по умолчанию получится видео 16:9. При необходимости задайте дополнительные настройки и запустите генерацию. А теперь — еще одна полезная функция Veo 3: озвучка текста из субтитров. Как озвучить текст из субтитров в Veo 3 Одна из неочевидных функций Veo 3 — распознавание текста на изображении, загруженном в качестве референса. Если добавить стартовый кадр с фотографией человека и текстом на изображении, нейросеть сможет использовать этот текст как субтитры и автоматически выполнит следующие действия: Прочтет текст, написанный на фотографии. Поймет, на каком языке он написан (поддерживаются разные языки). Поймет, какого возраста и пола персонаж, изображенный на фото. Если на референсе изображен не человек, а робот, мультяшный персонаж или кто-то иной, то голос будет автоматически подобран с подходящей тональностью. Озвучит текст из субтитров соответствующим голосом на нужном языке. ⚠️ Обратите внимание: чтобы Veo 3 озвучила текст из субтитров, нужно добавить промт к генерации. Например, можно написать: «человек говорит» или «человек поет песню», если вы хотите, чтобы персонаж не просто прочитал текст, а пропел его. Эта функция особенно полезна для блогов, видеоинструкций и массовой генерации контента для социальных сетей. С ее помощью можно быстро создавать ролики, в которых персонаж на фотографии озвучивает текст субтитров своим подходящим голосом. Вот пример такой генерации, исходное изображение на скриншоте: Результат озвучки субтитров: subtitles_audio_veo3.mp4 Рекомендуем также ознакомиться с другими статьями про Veo 3 — в них подробно разобраны дополнительные возможности нейросети: Базовые инструкции по использованию Veo 3 Как создавать длинные видео, с сохранением образов персонажей-

- генерация видео

- нейросеть

- (и ещё 3 )

-

Да, можно. Выбирайте в методах оплаты "Карты РФ"

-

qwen Ленин с пионерами поет гимн Союза: праздник детства и прогрессивной эпохи. Картинка из нейронной сети Qwen images Ai

admin опубликовал изображение в галерее в Qwen Images примеры промтов

Ленин с пионерами поет гимн Союза: праздник детства и прогрессивной эпохи - Пример работы нейросети Qwen images Ai Воодушевляющая картина эпохи советского единства и детства. На ней изображен Ленин, окруженный радостными пионерами в летнем лагере, исполняющими гимн Советскому Союзу. Атмосфера наполнена светом, прогрессом и оптимизмом, что подчеркивается обилием красного цвета – символа революции и надежды. Энергичные жесты детей, их восторженные лица и улыбка Ленина передают дух энтузиазма и сплоченности. Зеленые деревья на заднем плане создают контраст и подчеркивают гармонию между человеком и природой. Яркие красные галстуки пионерские значки и развевающиеся флаги СССР служат визуальным напоминанием об идеологии того времени. Стиль изображения выдержан в духе современного прогрессивного искусства, с использованием ярких насыщенных цветов и динамичной композицией, что придает картине современный вид. Световой эффект солнечного дня и общее праздничное настроение создают ощущение радости и беззаботности. Эта работа – ода советскому детству, патриотизму и вере в светлое будущее под мудрым руководством Ленина. По сути, это символ эпохи, запечатленный яркими красками и полным энтузиазма настроением, который вызывает ностальгию и воспоминания о времени надежд и перемен ✏️ Промт: Дедушка Ленин вместе с радостными пионерами в детском лагере поют гимн Советского Союза. Яркая, прогрессивная атмосфера, много красного цвета, энергичные жесты, восторженные лица детей, Ленин улыбается и поёт вместе с ними, вокруг зелёные деревья, пионерские галстуки, флаги СССР, стилизация под современное прогрессивное искусство, яркие, насыщенные цвета, динамичная композиция, светлый солнечный день, праздничное настроение 🧩 Нейросеть: 🐼 Qwen Images 🔨 Модель нейросети: QWEN.Basic 🔧 Сэмплер: euler 🎭 Стили: No style Этот рисунок создан нейронной сетью @yes_ai_bot- 1 комментарий

-

- пионеры

- советское искусство

- (и ещё 5 )

-

Если у вас VIP и при этом генерации были бесплатными, а потом стали платными, значит система увидела, что вы проявляете достаточно высокую активность в боте. Включается защита от злоупотреблений. Что можно сделать: подождать несколько часов. Важно: система не выдает ограничения на бесплатные генерации, если пользователь проводит в боте не все свое свободное время. Если действия человека похожи на среднестатистические, то проблем не будет. Что понимается под среднестатистическими действиями: нужно спать, нужно отвлекаться от бота, например на обеды, ужины и пр., НЕ НУЖНО использовать один аккаунт вместе с кем-то. Если же вы являетесь очень активным пользователем, то система временно ограничит бесплатные генерации. Если вы войдете в более размеренный режим использования бота, то бесплатные генерации вернутся автоматически. Если у вас VIP, и вы вообще не получаете бесплатные генерации, то проверьте, есть ли у вас хотя бы 4 активных приглашенных по реферальной ссылке. Количество активных можно узнать по команде /ref - отправьте ее боту.

-

отправьте сюда или в техподдержку @yes_ai_support исходные фотографии и скриншот настроек, которые вы делали, а также промт, которые указали в настройках

-

ОБНОВЛЕНИЕ: появилась возможность создавать видео "обнять себя маленького" с помощью функции "Elements" в нейросети Kling Ai, рекомендуем ознакомиться с описанием по этой ссылке: https://forum.yesai.su/topic/280-kling-ai-neyroset-videogenerator-dlya-animacii-izobrazheniy-v-telegram-bote/#elements

-

Это делают в Veo 3, но не всегда нейронка пропускает фотки с детьми. В промте не нужно упоминать детей, младенцев, это повысит шансы.

- 1 ответ

-

- 1

-

-

sora Изысканная индейка: праздничный шедевр для вашего стола. Генерация из нейронной сети Sora Images

admin опубликовал изображение в галерее в Sora Images примеры промтов

Изысканная индейка: праздничный шедевр для вашего стола - Генерация в нейросети Sora Images Изысканное воплощение традиционного праздника – аппетитная индейка, ставшим настоящим произведением кулинарного искусства. Сочная птица, словно вылепленная из красного кирпича, покоится на элегантной золотой тарелке, подчеркивая ее благородство и роскошь. Сцена разворачивается на фоне теплого деревянного дубового стола, добавляющего ощутимую нотку уюта и домашнего очарования. Эта фотография – идеальное решение для меню ресторана, стремящегося продемонстрировать безупречное качество и неповторимый вкус предлагаемого блюда. Создана с использованием профессиональной фотокамеры, она отличается высокой детализацией, позволяющей рассмотреть каждую текстуру и оттенок. Идеально подобранное освещение подчеркивает объемность и аппетитность индейки, вызывая непреодолимое желание попробовать это восхитительное угощение. Это не просто фотография блюда – это визуальный гимн празднику, обещающий незабываемый гастрономический опыт для каждого гостя. Внимание к деталям и безупречное исполнение делают этот снимок настоящим украшением любого меню, привлекающим внимание и вызывающим желание заказать именно эту индейку на день благодарения. Фотография отражает атмосферу торжества и радушия, создавая ощущение тепла и уюта. Идеальный выбор для ресторанов, стремящихся предложить своим гостям не просто еду, а настоящий праздник вкуса ✏️ Промт: индейка на день благодарения из красного кирпича на золотой тарелке на деревянном дубовом столе, фотография для меню ресторана, сьемка на профессиональную фотокамеру, профессиональная фотография блюда, высокая детализация, хорошее освещение 🧩 Нейросеть: 🦋 Sora Images 🎭 Стили: Shining Картинка создана с помощью нейронной сети - Yes Ai -

👉 Вы уже сейчас можете бесплатно пользоваться новой Chat GPT 5 в Yes Ai Bot [открыть в Telegram] (мы открыли основной функционал, все расширенные опции добавим в скором времени). Стоит ли новая рассуждающая модель внимания? Сейчас разберемся... Основные достоинства, заявленные Open Ai Автоматическое определение глубины рассуждений и степени подробности выдаваемых ответов (зависит от сути поставленных перед нейросетью задач). Модель показала превосходство над предыдущими версиями на ряде бенчмарков: математика (94,6% на AIME 2025), программирование (74,9% SWE-bench Verified), мультимодальное понимание, медицина (46,2% на HealthBench Hard). Улучшены генерация интерфейсов, отладка больших репозиториев, качество дизайна и эстетика, создание достаточно сложных приложений, игр и сайтов с помощью одного промпта. Сделать простенький сайт стало проще, но для профессионального подхода все равно требуется работа на специализированных движках, например, в WordPress и пр. Поэтому нужно разбивать задачи на подзадачи и решать их последовательно (не стройте иллюзий, что можно получить крутой проект уровня "PRO", отправив нейросети краткое описание задачи). Расширены возможности работы с изображениями, видео, мультимодальными и пространственными задачами. Актуализирована база знаний. GPT‑5 значительно улучшен в снижении уровня “поддакивания” - модель стала менее льстивой и более конструктивной в диалоге. Побочный эффект - ответы могут быть более скучными. Нейросеть честнее сообщает о невозможности решения задачи и реже демонстрирует излишнюю уверенность или дезинформацию по сравнению с предыдущими моделями. Для пользователей Yes Ai Bot Значительно увеличен объем ответов при решении сложных задач и написании программ и скриптов Недостатки GPT 5, выявленные при тестах Меньше креатива и рассуждений в диалогах, чем у предыдущих флагманских моделей GPT 4o и GPT o3. Многие пользователи отмечают, что ряд диалогов стали скучнее. Это связано с новыми фильтрами и тягой к лаконичности, но можно исправить ролями . Предварительный вердикт: модель действительно стоит вашего внимания, но ждать от нее прорывных результатов еще рано, разработчики из Open Ai уже в курсе выявленных недостатков и продолжают улучшать GPT 5. За этой моделью будущее, ждем фиксов. 🚩 Рекомендуем использовать GPT 5 для решения сложных задач и для разработки программного обеспечения, а GPT 5 mini - для получения ответов на вопросы (вместо гугла).

-

NSFW контент (от англ. not safe for work — «небезопасно для работы») — это нежелательный или запрещённый контент: текст, изображения, аудио и видео, содержащие откровенные, оскорбительные, жестокие или иные нежелательные элементы. Самый очевидный пример NSFW контента — материалы категории 18+. Термин NSFW часто используется в нейросетях и сервисах генерации контента, поскольку многие разработчики запрещают создавать нежелательные или опасные материалы. В частности, в нейросетях обычно нельзя генерировать изображения 18+, оскорбительные материалы, дипфейки, сцены насилия и другой запрещённый контент. Какие материалы относятся к NSFW контенту: материалы с изображением или описанием обнажённых частей тела; тексты, видео, аудио и изображения, содержащие оскорбительный контент, в том числе по религиозным, расовым или иным признакам; дипфейки — изображения или видео, в которых показаны люди или события, не имеющие отношения к реальности. Например, запрещено использовать нейросети для подстановки чужого лица на фото или в видео; некоторые компании, например Google, запрещают использовать фотографии несовершеннолетних в качестве референсов. Такой контент сам по себе не всегда относится к NSFW, но теоретически может быть использован в незаконных целях. Даже такой невинный промт, как «Мама обнимает сына», может быть отклонён; любые материалы, содержащие сцены жестокости, насилия, издевательства над животными и другие подобные элементы. Обратите внимание: создание или использование NSFW контента в отдельных случаях может повлечь административную или уголовную ответственность. Как нейросети определяют NSFW контент автоматически Почти все современные нейросети умеют автоматически определять NSFW и другой нежелательный контент с достаточно высокой точностью. Например, если вы используете запрещённые слова в промте или загружаете референсы с обнажёнными людьми, запрос может быть автоматически отклонён. Иногда нейросети ошибаются: даже на безобидной фотографии система может обнаружить нежелательный контент. В этом случае лучше использовать другое изображение в качестве референса. Важно: не стоит писать в промтах фразы вроде «не рисуй обнажённых людей» или «без жестокости», так как само наличие таких слов может сделать запрос небезопасным для системы модерации. В таких случаях нейросети часто игнорируют отрицание и реагируют прежде всего на наличие запрещённых слов и фраз. Все промты должны быть составлены так, чтобы у системы не возникало оснований отклонить запрос из-за формулировок. Антоним термина NSFW — SFW (safe for work). SFW контент — это безопасные материалы, не содержащие нежелательных элементов. Если вам нужен безопасный контент для генерации в нейросетях, следует использовать SFW-формулировки и нейтральные запросы.

- 3 ответа

-

- 5

-

-

-

- nsfw

- not safe for work

-

(и ещё 1 )

C тегом:

-

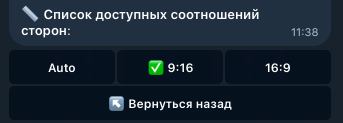

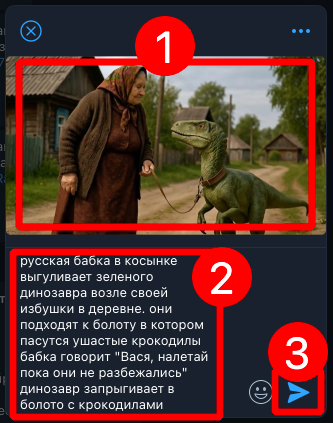

нейробабка Мем про нейробабушку из нейросети Veo 3

admin опубликовал изображение в галерее в Видео из нейросетей

Мемы про нейробабушку стали очень популярны с момента выхода нейросети Veo 3, так как она способна генерировать видео не просто со звуком, но и с озвучкой диалогов персонажей. Вы можете создавать собственные мемы про нейробабку и на другие темы, в этом вам поможет Телеграм-бот с доступом к нейросети Veo 3 (регистрация в сторонних сервисах не требуется). В боте Yes Ai поддерживаются промты на любых языках, в том числе на русском. В качестве референсов вы можете использовать свои картинки и фотографии. Ссылка на бота с доступом к Veo 3: https://t.me/yes_ai_bot?start=_veo Подробная инструкция о том, как было создано это видео находится тут: https://forum.yesai.su/topic/2290-kak-generirovat-memy-pro-neyrobabku-v-neyroseti-veo-3- 1 комментарий

-

- veo 3

- нейробабушка

-

(и ещё 2 )

C тегом:

-

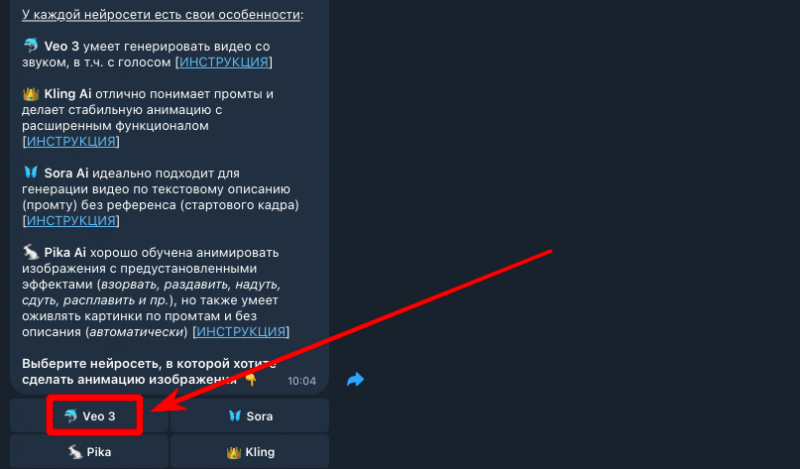

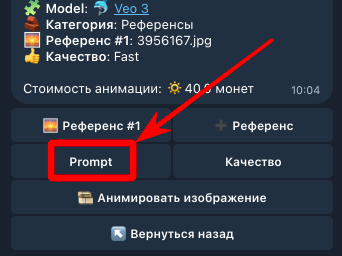

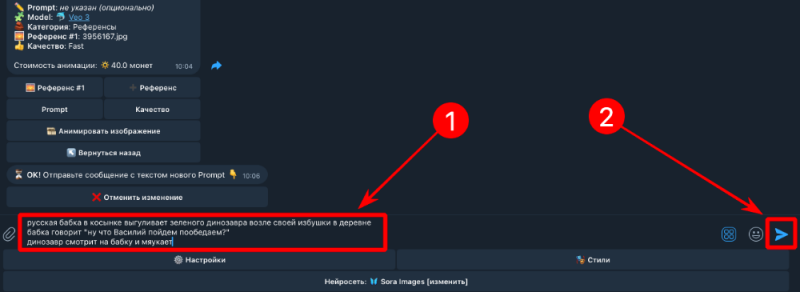

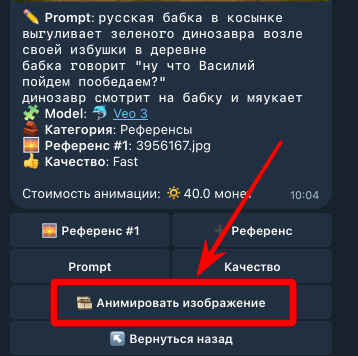

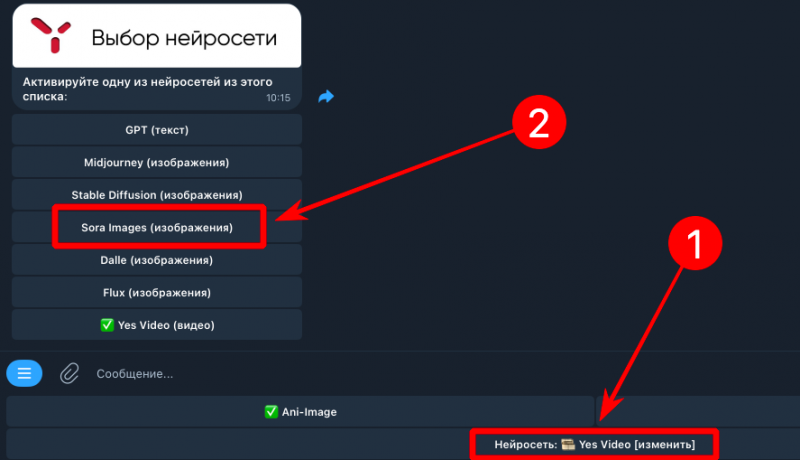

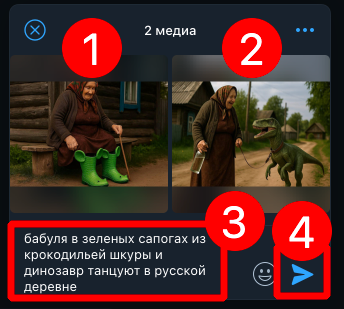

veo 3 Как генерировать мемы про нейробабку в нейросети Veo 3

admin опубликовал тема в Нейросети для Видео

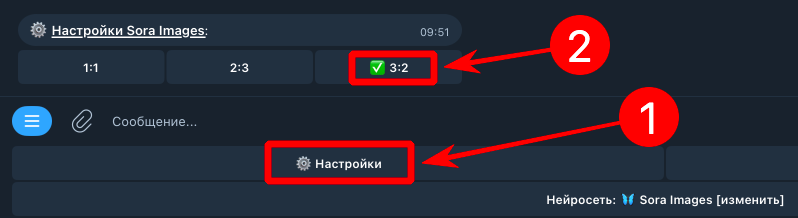

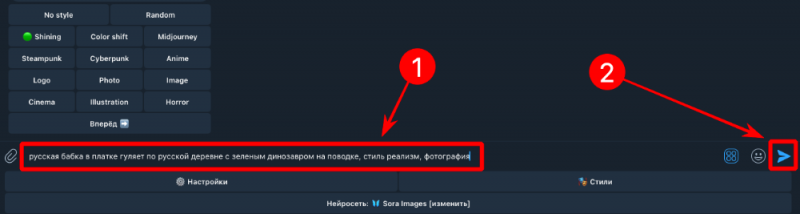

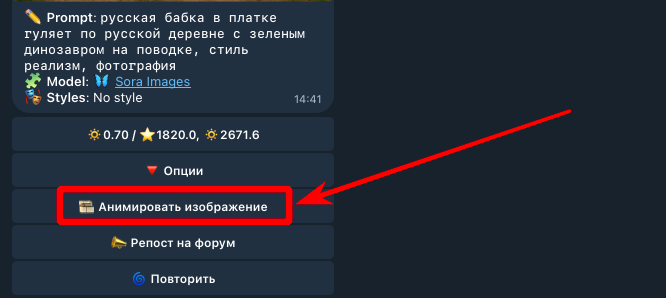

Нейробабка — популярный формат мемов и коротких видео, которые создают в Veo 3. В этой статье мы пошагово разберем, как создать мем в Veo 3, как сделать персонажа, сохранить его внешний вид в разных сценах, продлить видео и написать промпты с диалогами. Veo 3 умеет генерировать видео с озвучкой персонажей, поэтому эту нейросеть часто используют для создания мемов, рекламных роликов и развлекательного контента. Что вы узнаете из этой инструкции по Veo 3: как создать персонажа для видео в Veo 3 на примере нейробабушки; как сохранить внешний вид персонажа в разных фрагментах видео, если Veo 3 генерирует ролики по 8 секунд; как продлить видео в нейросети Veo 3; как писать промты с диалогами. Какие нейросети нужны, чтобы создать мемы и видео в Veo 3 Veo 3 дает более качественный результат, если использовать не только промпт, но и стартовый кадр, а при необходимости — и финальный кадр. Поэтому для стабильной генерации видео рекомендуем работать именно по такой схеме: генерируйте стартовый кадр (картинку) для каждого фрагмента видео через нейросеть Sora Images. Также можно поэкспериментировать с сочетанием стартового и финального кадров; оживляйте полученные картинки в Veo 3 с использованием промтов (их можно писать на русском языке, если используете Yes Ai Bot). Примечание: если генерировать видео в Veo 3 без референса, только по текстовому описанию, могут возникнуть проблемы: голос персонажа может не соответствовать образу, а внешний вид персонажей и локаций будет сложно сохранять в разных фрагментах видео. Посмотрите этот видеоролик, на его примере мы сделаем разбор всех этапов 👇 neurobabka_w.mp4 В каждом шаге инструкции мы дадим практические советы, которые помогут сократить число лишних генераций, сэкономить бюджет и получить более качественный результат. Рекомендуем создать собственные сюжеты и персонажей, а не использовать те, которые приведены в нашей инструкции. Шаг 1 Как написать сюжет и промпты для видео в Veo 3 Перед началом генерации подготовьте сюжет и промпты для каждого 8-секундного фрагмента видео в Veo 3 — так вы не будете тратить бюджет на лишние генерации. В среднем сюжет может состоять из 2 — 6 отрезков, однако на этапе обучения можно создавать ролики из 1 отрезка. Примечание: Veo 3 генерирует видео в горизонтальном формате, поэтому для Shorts, Reels, клипов и TikTok готовый ролик придется адаптировать под вертикальное видео. К этому вопросу мы еще вернемся в конце статьи. Шаг 2 Как создать внешний вид персонажа и референс в Sora Images для Veo 3 Sora Images удобно использовать вместе с Veo 3, потому что эта нейросеть помогает быстро создавать стартовые кадры и референсы, понимает русский язык и поддерживает работу с изображениями-образцами. Этого набора качеств более чем достаточно. открываем нейросеть Sora Images по этой ссылке https://t.me/yes_ai_bot?start=_soraimages выбираем в настройках горизонтальный формат (соотношение сторон 3:2); (необязательно) включаем стиль "Shining", чтобы нейросеть рисовала более яркие изображения (без применения этого стиля они могут получиться слишком блеклыми); отправляем боту промт: русская бабка в платке гуляет по русской деревне с зеленым динозавром на поводке, стиль реализм, фотография Результат генерации 👇 Примечание: нейросеть Sora Images позволяет создавать самые безумные и оригинальные сцены, она хорошо осведомлена о том, как должны выглядеть не только русские ИИ бабушки, но и произвольные локации в разных странах мира, в т.ч. в России. Другие нейросети (в том числе Midjourney) с этой задачей справиться не способны. Шаг 3 Как сгенерировать первый фрагмент видео в Veo 3 по референсу Выбираем картинку из Sora Images, которая больше всего удовлетворяет вашим запросам (имеются ввиду изображения, созданные на предыдущем шаге инструкции); нажимаем кнопку "🎞️ Анимировать изображение"; в появившемся меню выбираем нейросеть "🐬 Veo 3"; нажимаем кнопку "Prompt" (с ее помощью можно задать текстовое описание будущей генерации); отправляем боту текстовое описание того, что должно происходить в первой сцене: русская бабка в косынке выгуливает зеленого динозавра возле своей избушки в деревне бабка говорит "ну что Василий пойдем пообедаем?" динозавр смотрит на бабку и мяукает нажимаем кнопку "🎞️ Анимировать изображение" и ждем результата (несколько минут). Результат генерации 👇 352976447_1753358026596320.mp4 Примечание: на этом этапе мы получим ролик, который потом будем дополнять новыми фрагментами. Если вам не понравилась созданная генерация, то повторите ее + при необходимости внесите правки в свой промт. Примечание: если использовать Veo 3 не через @yes_ai_bot, а в Google Flow, то вводить промт придется на английском, так как оригинальная версия нейросети крайне неохотно работает с русским языком... в этом случае на русском языке пишите исключительно текст диалогов, который "написан в кавычках". Шаг 4 Как продлить видео в Veo 3 с помощью финального кадра На момент написания статьи Veo 3 не умеет автоматически продлевать видео, но это можно обойти: достаточно сделать скриншот последнего кадра из предыдущего 8-секундного фрагмента и использовать его как стартовый кадр для новой сцены. Делаем скриншот последнего кадра из видео, созданного на шаге номер 3; переключаемся в боте на нейросеть Veo 3 (если вы все делали по инструкции, то в нижнем меню все еще будет активирована нейросеть Sora Images, в которой мы создавали картинку), для этого можно просто перейти по этой ссылке https://t.me/yes_ai_bot?start=_veo отправляем боту сделанный 📎 скриншот + текстовое описание того, что должно происходить во втором фрагменте видео: русская бабка в косынке выгуливает зеленого динозавра возле своей избушки в деревне. они подходят к болоту в котором пасутся ушастые крокодилы бабка говорит "Вася, налетай пока они не разбежались" динозавр запрыгивает в болото с крокодилами выбираем нейросеть Veo 3 и нажимаем кнопку "🎞️ Анимировать изображение". Примечание: создавая видео для этой статьи мы не стали точно подбирать финальный кадр для скриншота, поэтому в итоговом варианте будет видна небольшая склейка, но вам следует внимательнее отнестись к этому этапу, если хотите получить бесшовный переход между сценами. Примечание: голос персонажа может отличаться в разных фрагментах видео, решение — делать несколько генераций в Veo и выбирать ту из них, в которой голос и интонация соответствуют вашим ожиданиям. Шаг 5 Как сохранить внешний вид персонажа в разных фрагментах видео в Veo 3 На этом шаге разберем простой способ, который помогает сохранять лица, одежду и детали сцены при создании новых фрагментов видео. Еще в начале статьи мы сделали акцент на том, что лучшим другом Veo является нейросеть Sora Images, и вот почему: она очень хорошо умеет использовать референсы, т.е. вы можете создавать новые изображения используя в качестве исходников собственные картинки и фотографии. Эта особенность позволит воссоздать образ бабки, ее одежду, внешний вид динозавра и даже окружение, при этом мы сможем поместить их в новую локацию. По нашему сюжету в следующем фрагменте динозавр и бабка должны убегать от ушастых 🤪 крокодилов, погнали... Вернемся в нейросеть Sora Images, так как сейчас требуется создать новый стартовый кадр для следующего фрагмента видео, поэтому пора научиться переключать нейросети в Yes Ai Bot через нижнее меню. В нижнем меню нажимаем кнопку "Нейросеть 🎞️ Yes Video [изменить]"; в появившемся списке кликаем "Sora Images"; отправляем боту самую первую картинку, которую анимировали на шаге номер 3, ее можно скопировать прямо из исходника и отправить боту + делаем текстовое описание того, что должно находиться в первом кадре будущего видео: бабка с динозавром убегают от ушастых крокодилов, стиль реализм, фотография Результат генерации 👇 Примечание: нейросети Veo 3 и Sora Images не всегда будут генерировать картинки и видео, которые в 100% случаев вас удовлетворят, поэтому имейте ввиду, что работа с нейросетями — это всегда перебор вариантов и корректировка промтов! Не питайте иллюзий по поводу того, что классные картинки и видео можно создать за пару кликов. Когда вы накопите некоторый опыт, тогда сможете создавать качественные ролики чуть ли не с первой попытки. Мы вас предупредили, теперь идем дальше. Шаг 6 Проверяем, как Veo 3 работает с эмоциональными репликами и разговорной речью Спойлер: умеет мат******ся. Тестируем... По аналогии с тем, как мы делали на шаге номер 3, нажимаем кнопку "🎞️ Анимировать изображение" под той картинкой, которая больше подходит по стилю: опять выбираем нейросеть Veo 3 и т.д.; в "Prompt" вставляем описание для анимации: русская бабка в косынке вместе с зеленым динозавром убегают в страхе от разъяренных ушастых крокодилов бабка кричит "прости, откуда же мне было знать, что они еба***ые" Примечание: мы предостерегаем вас от использования любых нейросетей с целью создания оскорбительного контента и дипфейков, это может повлечь за собой вполне реальные последствия. Не пытайтесь создать в Sora и Veo 3 контент категории 18+, обе нейросети откажут в этом, более того, вы можете получить пожизненный бан в системе Yes Ai за злоупотребления. Шаг 7 Закрепляем на практике шаги из пунктов 5 и 6 Теперь мы повторим процедуру создания стартового кадра с теми же персонажами, но поместим их в новую локацию — в темный подвал. Включаем нейросеть Sora Images (см. шаг номер 5); в качестве референса используем ту же картинку, из которой делали самую первую анимацию на шаге номер 3 + пишем промт: бабушка с динозавром сидят в подвале, на потолке светит лампочка, у бабушки в руке бутылка с самогоном. стиль реализм, фотография теперь анимируем полученный референс в Veo 3 (по аналогии с шагом номер 6), промт: русская бабка в косынке вместе с динозавром зеленого цвета прячутся в подвале бабка говорит "фу, кое как оторвались от этих психов" бабка достает бутылку самогона и пьет из нее бабка говорит "нужно немного снять стресс" бабка протягивает бутылку с самогоном динозавру и спрашивает "а ты будешь стресс снимать ?" Шаг 8 Продолжаем создавать новые сцены в Veo 3 Как видите, если у вас готовы референсы и сюжет с диалогами, то создание новых фрагментов видео — это повторение шагов, описанных в 5-м и 6-м пунктах, поэтому не будем их по-новой описывать, просто приведем промты, которые использовали для создания изображений и видео... [Sora Images] бабка с динозавром идут по деревенской улице, у бабки в руке бутылка самогона [Veo 3] бабка с зеленым динозавром идут по деревенской улице бабка говорит на русском "ну что малыш, пошли надерем задницы этим лохобесам" бабка с динозавром подходят к болоту, в котором тусуются ушастые крокодилы бабка говорит "ну что, ушастые мешки, пришла ваша смерть" Шаг 9 Продолжаем сюжетную линию [Sora Images] бабуля сидит на скамейке рядом с избушкой, бабуля надевает на ноги ярко-зеленые ушастые сапоги из крокодильей шкуры. из сапогов торчат круглые уши ушастых крокодилов [Veo 3] бабуля говорит на русском "вот это обновочка! какие крутые говноступы получились, Тамара Ильинична обзавидуется" Шаг 10 Может ли Veo 3 создавать музыкальные фрагменты и песни Спойлер: умеет, но есть одно "но". Теперь попробуем создать фрагмент видео, в котором попросим нейросеть спеть песню. Учтите, что музыку и песни Veo 3 делать "условно" умеет, но она не предназначена для этих целей, так что результат не всегда удовлетворителен. На этом этапе хотим обратить ваше внимание, что Sora Images умеет использовать в качестве референсов не одно изображение, а несколько (до 10 штук). Нам это пригодится, потому что у нас уже есть два референса: изображение бабки в зеленых сапогах из крокодильей шкуры и первое изображение, на котором вместе показаны бабка и динозавр. Нам нужно чтобы в следующем референсе бабка была в своих новых сапожках, но при этом и про динозавра мы забывать не планируем, поэтому используем две картики в качестве референсов в Sora Images. Запускаем Sora Images (см. шаг номер 5); отправляем боту сразу две картинки в одном сообщении (стандартная функция прикрепления изображений в Telegram — можно отправлять по несколько картинок за раз) + пишем простой промт: бабуля в зеленых сапогах из крокодильей шкуры и динозавр танцуют в русской деревне Анимируем полученный референс в Veo 3 по промту: бабуля и динозавр танцуют под песню калинка малинка Шаг 11 Монтаж и склейка фрагментов после генерации видео в Veo 3 В этой статье мы не будем подробно разбирать все этапы монтажа, но дадим пару вводных... Рекомендуемые приложения для монтажа и склейки видео: для Windows, macOS, iOS, Android и пр.: CapCut; для macOS и iOS: iMovie (простой в освоении, без лишних функций); для Windows и macOS: DaVinci Resolve (профессиональное приложение для обработки видео с множеством плагинов и расширенных возможностей). Гайдов по использованию этих приложений существует огромное множество, мы уверены, что вы разберетесь самостоятельно 👍 Результат монтажа Вот что у нас получилось из приведенных ранее фрагментов с добавлением пустых блоков сверху и снизу 👇 neurobabka_h.mov Итоги Связка Veo 3 и Sora Images позволяет создавать мемы, короткие видео, сюжеты и клипы с постоянными персонажами даже без сложного продакшена. Более широкие возможности доступны за счет других нейросетей: замена лица на фотографии (для генерации референсов с собственным ликом); замена лица в видео; апскейл видео (увеличение качества и разрешения роликов); увеличение FPS и пр. ❤️ Поставьте лайк, если этот гайд был полезен 👇- 2 ответа

-

- 4

-

-

-

-

- нейробабушка

- нейробабка

- (и ещё 7 )

-

Бесшовная склейка, это возможно?

admin ответил VitalyB вопрос в Вопросы о нейросетях и ответы на них

Попарно складывайте картинки друг с другом в любом редакторе, а потом попробуйте швы сгладить с помощью INPAINT : https://forum.yesai.su/topic/85-obrabotka-foto-bez-fotoshopa-s-pomoschyu-neyroseti-onlayn-zamena-lica И это нужно будет проделать со всеми элементами по-отдельности. -

более точную замену лица лучше делать на этапе пост-обработки, подробнее тут - https://forum.yesai.su/topic/380-zamena-lica-na-foto-v-telegram-kak-sozdat-deepfake-onlayn/ Ответ: никак. У Sora IMG нет опции, отвечающей за температуру и вариативность. решается это исключительно на уровне промта. И НЕТ, это не так сильно зависит от количество шагов сэмплинга. Тоже никак, параметр Sampling Steps недоступен в настройках Sora Images.